Mon ami Jean-Philippe (@jcunniet ) me signale un excellent article (merci !) paru dans The Guardian, a propos des développements de la reconnaissance faciale, et du traitement par des algorithmes des expressions sur notre visage. Sans surprise, nous avons là, la confirmation qu’à force de scruter des millions de visages dans le monde, une machine pourrait reconnaître, voire détecter les humeurs basiques de passants ou de clients. La peur, la colère, peut-être aussi le dégout ou la tristesse seraient bien lisibles quant nous les ressentons. Des chercheurs, une entreprise spécialisée (Affectiva), publient de nombreux messages pour promouvoir leurs avancées et clament une amélioration décisive de la pertinence des machines, après un long apprentissage.

Or, le médicament britannique nous prévient, il n’en est rien, ou presque ! En effet, les biais cognitifs sont encore énormes, les différences culturelles également et au final, appliqué à un individu unique, la performance de la machine reste très aléatoire. De mon côté, je m’étonne que l’on ne puisse analyser les deux émotions positives basiques que sont la joie et la surprise. Je m’inquiète aussi que l’on s’en tienne à ces bases là, lorsque nous ressentons des émotions nettement plus complexes (au moins 27 émotions différentes)… Pire, je suis choqué que la machine soit trompée par la couleur de peau ou l’appartenance à une culture différente (cf l’excellent point sur le japonais émigré au Brésil ou le brésilien devenu japonais… ont-ils les mêmes expression du visage ? ressentent-ils la même chose en face d’une même situation ?)…

Les émotions sont bien plus compliquées à expliquer que cela. Les chercheurs se creusent la tête pour comprendre comment elles naissent, comment notre cerveau les conscientisent, comment notre centre de contrôle nerveux laisse nos muscles du visage les traduire ou les retenir… Ne sommes-nous pas capables de sourire, ou de rester de marbre, pour faire bonne figure, y compris dans des face à face douloureux ou gênants ?

Il m’arrive d’être déçu, d’être furieux et de ne rien laisser paraître, grâce à mon légendaire flegme britannique ! Il m’arrive aussi de sourire de façon très impertinente et cela m’a valu depuis toujours, des remarques (justifiées) de ceux qui en sont déstabilisés. Chacun exprime ou retient ses émotions selon des codes sociaux établis et contestables. On peut rire nerveusement ou pleure de joie, et je ne suis pas prêt à croire qu’une machine puisse, d’une part le comprendre, d’autre part, l’exprimer correctement en retour. D’ailleurs, sur ce dernier point, faut-il te rappeler, cher.e lecteur.trice, que l’émotion se transmet d’humain à humain, pas seulement par le regard. On peut la ressentir, elle nous transperce parfois dans le noir complet ; elle s’agrège aussi et la foule amplifie ses effets de façon magique (lorsqu’une salle entière se lève pour une standing ovation, par exemple).

Alors, cher Jean-Philippe, sans vouloir ici contester que la recherche fait d’immenses progrès, je préfère retenir que nous sommes très loin de comprendre ce qui nous émeut, et c’est tant mieux. L’amour reste ainsi hors de portée de la machine !

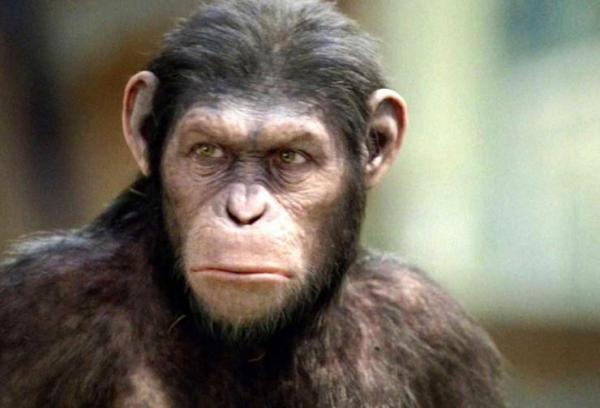

Généraliser et scorer à partir de grandes quantités de data, n’est pas toujours une bonne idée. Nier l’unicité de l’être humain est une erreur grave que la science elle-même n’ose pas, tant notre ADN est rendu unique pour quelques infimes variations, qui font pourtant toute la différence. Nous sommes en pourcentage de similitude d’ADN très proches de certains animaux et pourtant totalement différents. Lorsqu’un machine ou. un algorithme affichera 100% de résultats conformes, nous pourrons nous avouer vaincus. Pour le moment et pour longtemps encore, nous sommes des humains et nos différences sont justement notre sensibilité et nos émotions.

Human first !

Lire l’article ici : https://www.theguardian.com/technology/2019/mar/06/facial-recognition-software-emotional-science